Modèle Profond pour la Détection des Risques de Deepfakes Malveillants

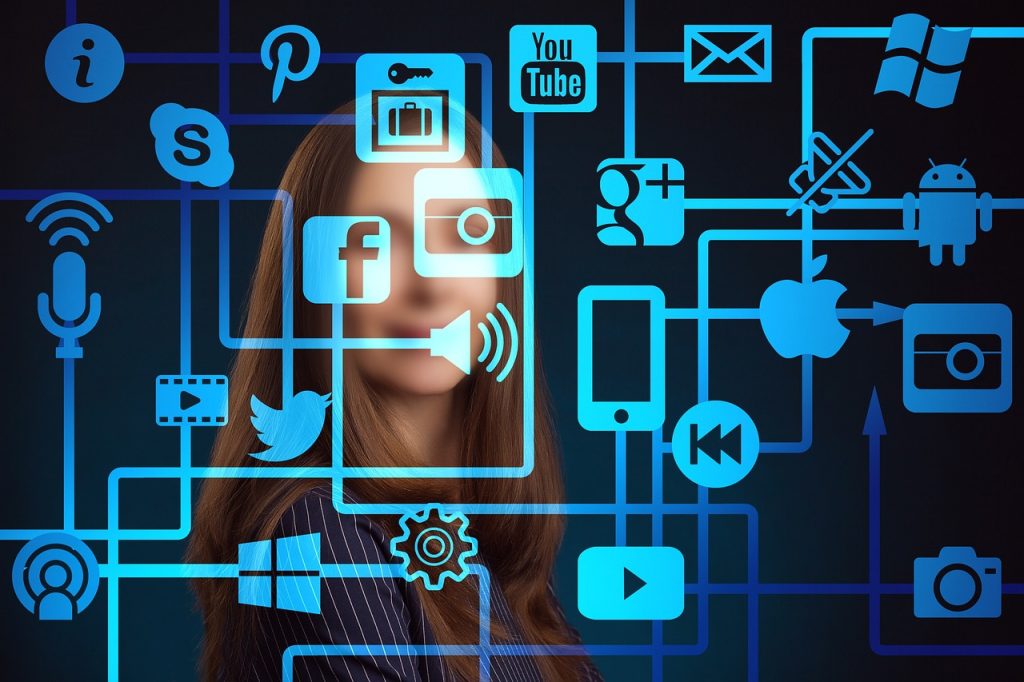

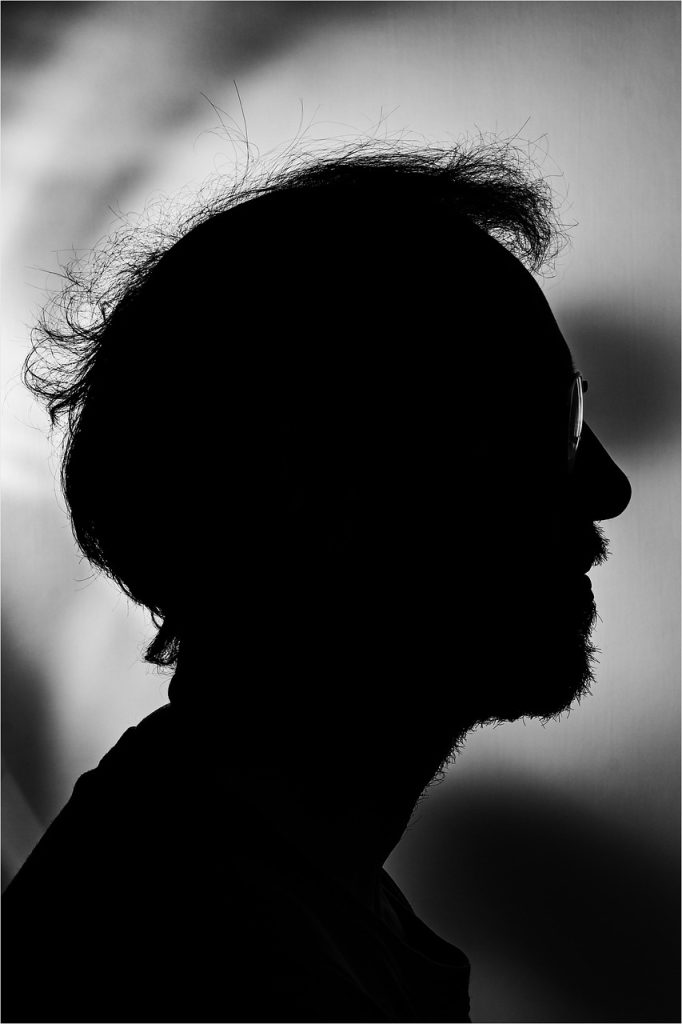

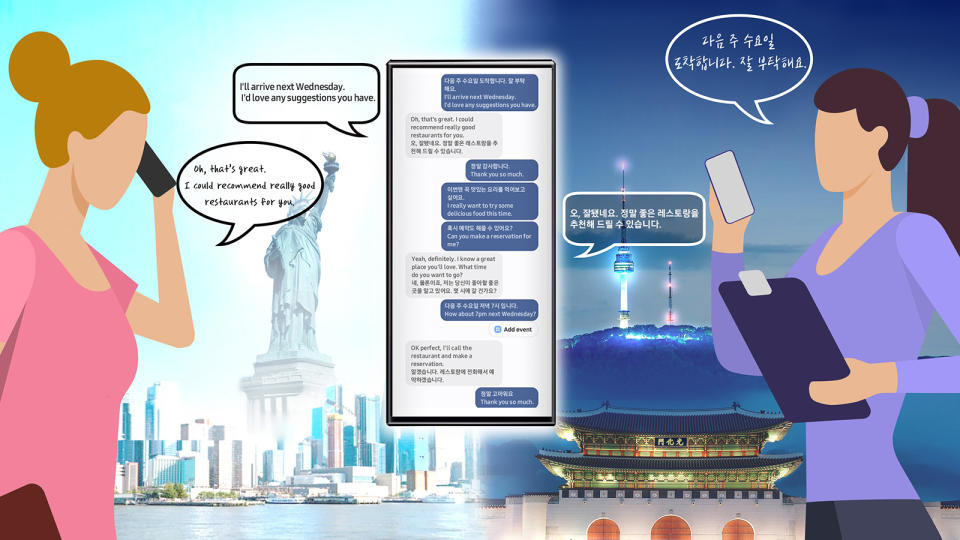

Alors que la technologie numérique continue d’évoluer, les menaces posées par les acteurs malveillants exploitant ces avancées se multiplient également. L’une des préoccupations les plus pressantes de ces dernières années est la montée des deepfakes, des médias synthétiques dans lesquels une personne dans une image ou une vidéo existante est remplacée par la ressemblance de quelqu’un d’autre. Bien que la technologie derrière les deepfakes puisse être utilisée à des fins créatives et bénignes, le potentiel d’abus pose des risques significatifs pour les individus, les organisations et les sociétés à l’échelle mondiale. Cet article examine le déploiement de modèles d’apprentissage profond comme solution pour détecter les deepfakes malveillants et atténuer les risques associés.

Comprendre les Deepfakes

Les deepfakes sont générés à l’aide de techniques d’apprentissage profond, en particulier les réseaux antagonistes génératifs (GAN). Ces modèles peuvent créer des images, des sons et des vidéos extrêmement réalistes qui sont presque indiscernables des médias authentiques. La sophistication de la technologie des deepfakes a progressé au point où les méthodes de détection traditionnelles ne suffisent plus, nécessitant le développement de solutions plus robustes.

L’Impact Mondial des Deepfakes

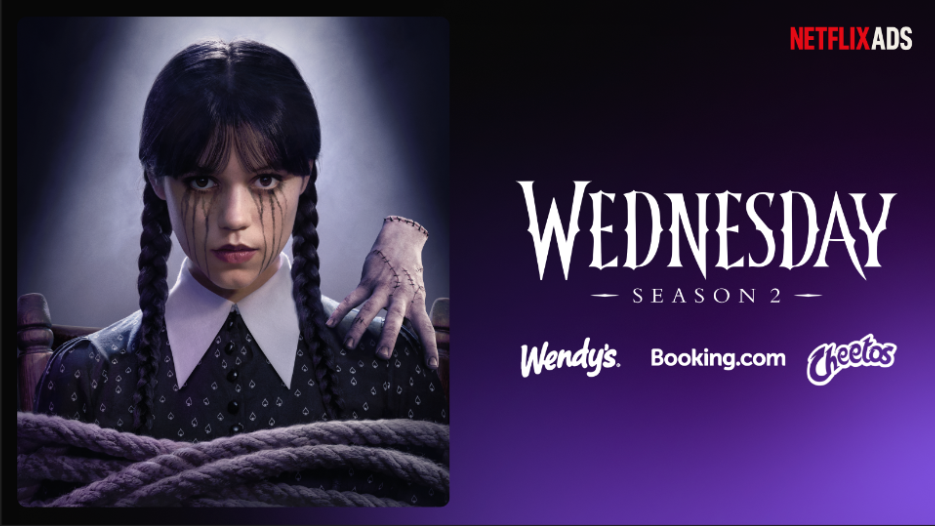

Les implications des deepfakes sont vastes et multiformes. Politiquement, les deepfakes ont le potentiel de perturber les processus électoraux, de propager de la désinformation et d’éroder la confiance dans les institutions publiques. Économiquement, les entreprises sont confrontées à des défis pour protéger leurs marques et leur propriété intellectuelle contre les activités frauduleuses. Sur le plan personnel, les individus peuvent subir des dommages réputationnels ou des atteintes à la vie privée. Pour faire face à ces défis, un effort concerté est nécessaire dans plusieurs secteurs, y compris la technologie, la gouvernance et l’application de la loi.

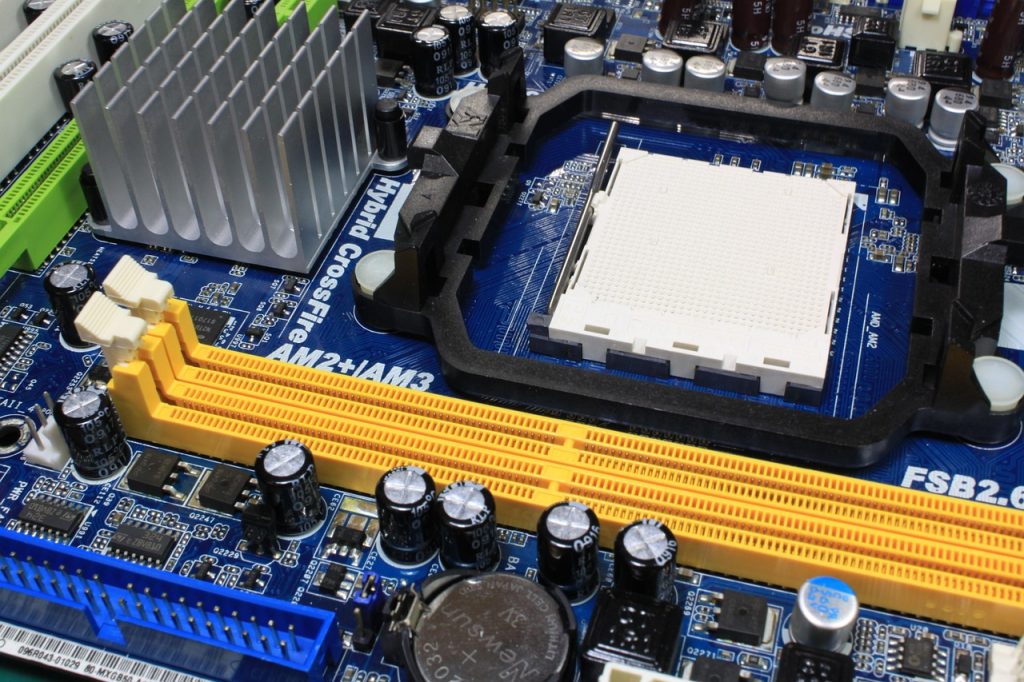

Modèles d’Apprentissage Profond pour la Détection

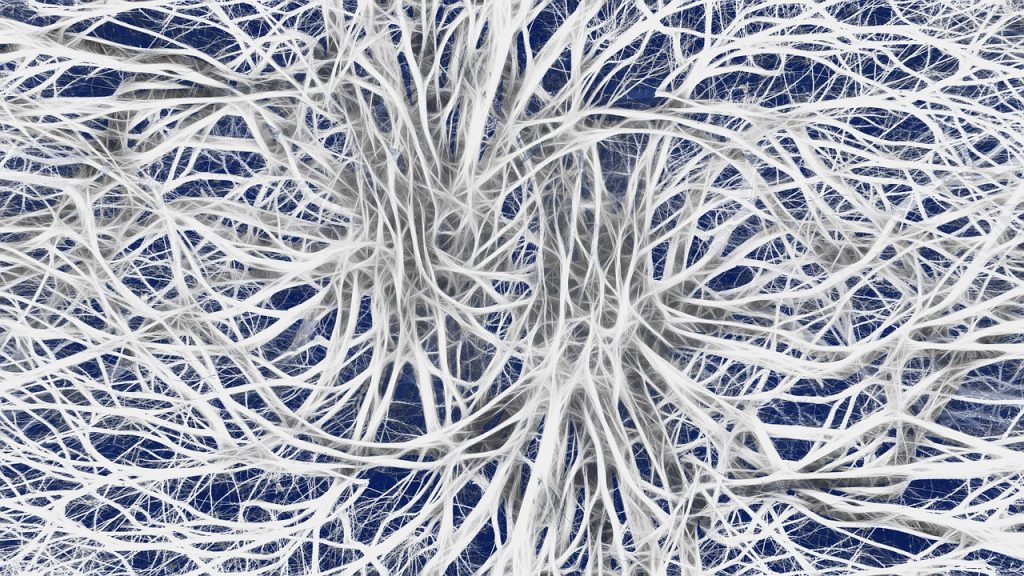

Les modèles d’apprentissage profond, en particulier les réseaux de neurones convolutifs (CNN) et les réseaux de neurones récurrents (RNN), ont montré leur potentiel pour détecter les deepfakes. Ces modèles sont entraînés sur de vastes ensembles de données de médias réels et synthétiques, apprenant à identifier les incohérences subtiles et les artefacts indicatifs des deepfakes.

- Réseaux de Neurones Convolutifs (CNN) : Les CNN excellent dans les tâches de reconnaissance d’images et sont efficaces pour analyser les images des vidéos à la recherche de divergences dans les expressions faciales, l’éclairage et les ombres.

- Réseaux de Neurones Récurrents (RNN) : Les RNN, en particulier les réseaux à mémoire à long court terme (LSTM), sont habiles à traiter les séquences et sont utilisés pour détecter les anomalies dans la parole et la dynamique des vidéos au fil du temps.

Défis dans la Détection des Deepfakes

Malgré les capacités des modèles d’apprentissage profond, plusieurs défis persistent dans la détection des deepfakes :

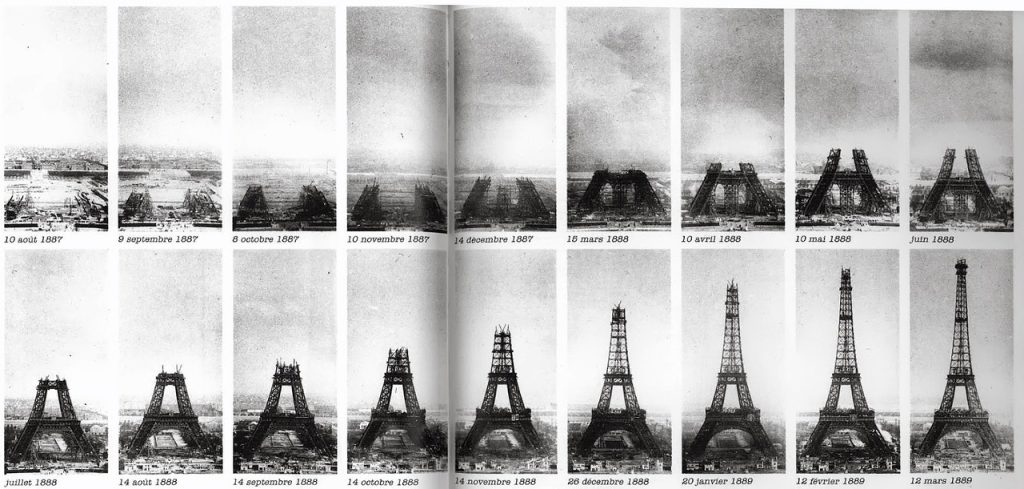

- Évolution Rapide : La technologie des deepfakes évolue continuellement, rendant difficile pour les modèles de détection de suivre le rythme des nouvelles techniques qui produisent des contrefaçons encore plus convaincantes.

- Rareté des Données : Des ensembles de données de haute qualité de deepfakes et de médias authentiques sont essentiels pour entraîner les modèles de détection. Cependant, la disponibilité de tels ensembles de données est limitée, ce qui peut affecter l’efficacité de ces modèles.

- Généralisation : Les modèles doivent être capables de se généraliser à une variété de types de deepfakes et de contextes, ce qui nécessite un entraînement et une validation étendus.

Stratégies pour l’Atténuation

Pour atténuer les risques associés aux deepfakes malveillants, une approche à multiples facettes est nécessaire :

- Collaboration : La collaboration entre les entreprises technologiques, les institutions académiques et les gouvernements est cruciale pour développer des outils de détection efficaces et partager des informations sur les menaces émergentes.

- Sensibilisation du Public : Éduquer le public sur l’existence et l’impact potentiel des deepfakes peut aider les individus à évaluer de manière critique les médias qu’ils consomment.

- Cadres Réglementaires : La mise en œuvre de cadres juridiques pour aborder la création et la distribution de deepfakes malveillants peut dissuader les contrevenants potentiels et offrir un recours aux victimes.

Conclusion

L’émergence des deepfakes représente un défi important à l’ère numérique, nécessitant des solutions innovantes pour détecter et atténuer leur impact. Les modèles d’apprentissage profond offrent une voie prometteuse pour identifier les deepfakes malveillants, mais la recherche continue et la collaboration sont essentielles pour anticiper les menaces évolutives. En exploitant le pouvoir de la technologie et en favorisant un dialogue mondial, la société peut s’assurer que les avantages de l’innovation numérique ne sont pas éclipsés par ses risques.